Ի՞նչ է Robots.txt ֆայլը: Այն ամենը, ինչ Ձեզ անհրաժեշտ է SEO-ի համար ռոբոտների ֆայլը գրելու, ներկայացնելու և վերաքայլելու համար

Մենք գրել ենք համապարփակ հոդված ինչպես են որոնման համակարգերը գտնում, սողում և ինդեքսավորում ձեր կայքերը. Այդ գործընթացում հիմնարար քայլ է robots.txt ֆայլը, որոնիչի դարպասը՝ ձեր կայքը սողալու համար: Հասկանալը, թե ինչպես ճիշտ կառուցել robots.txt ֆայլը, կարևոր է որոնման համակարգի օպտիմալացման համար (SEO).

Այս պարզ, բայց հզոր գործիքն օգնում է վեբ վարպետներին վերահսկել, թե ինչպես են որոնման համակարգերը փոխազդում իրենց կայքերի հետ: Robots.txt ֆայլի ըմբռնումը և արդյունավետ օգտագործումը կարևոր է կայքի արդյունավետ ինդեքսավորման և որոնման արդյունքներում օպտիմալ տեսանելիության ապահովման համար:

Ի՞նչ է Robots.txt ֆայլը:

Robots.txt ֆայլը տեքստային ֆայլ է, որը գտնվում է կայքի արմատական գրացուցակում: Դրա հիմնական նպատակն է ուղղորդել որոնողական համակարգերի սողացողներին, թե կայքի որ մասերը պետք է կամ չպետք է սուզվեն և ինդեքսավորվեն: Ֆայլը օգտագործում է Robots Exclusion Protocol (REP), ստանդարտ վեբկայքեր, որոնք օգտագործում են վեբ սողացողների և այլ վեբ ռոբոտների հետ հաղորդակցվելու համար:

REP-ը ինտերնետի պաշտոնական ստանդարտ չէ, սակայն լայնորեն ընդունված և աջակցվում է խոշոր որոնման համակարգերի կողմից: Ընդունված ստանդարտին ամենամոտը խոշոր որոնողական համակարգերի փաստաթղթերն են, ինչպիսիք են Google-ը, Bing-ը և Yandex-ը: Լրացուցիչ տեղեկությունների համար այցելեք Google-ի Robots.txt-ի բնութագրերը խորհուրդ է տրվում.

Ինչու է Robots.txt-ը կարևոր SEO-ի համար:

- Վերահսկվող սողալ. Robots.txt-ը թույլ է տալիս վեբ կայքերի սեփականատերերին թույլ չտալ որոնողական համակարգերին մուտք գործել իրենց կայքի որոշակի բաժիններ: Սա հատկապես օգտակար է կրկնօրինակ բովանդակությունը, մասնավոր տարածքները կամ զգայուն տեղեկություններով բաժինները բացառելու համար:

- Օպտիմիզացված Crawl բյուջե. Որոնման համակարգերը յուրաքանչյուր վեբկայքի համար հատկացնում են սկանավորման բյուջե, այն էջերի քանակը, որոնք որոնման համակարգի բոտը կսողարկի կայքում: Արգելելով անհամապատասխան կամ պակաս կարևոր բաժինները՝ robots.txt-ն օգնում է օպտիմալացնել սկանավորման այս բյուջեն՝ ապահովելով, որ ավելի նշանակալից էջերը որոնվեն և ինդեքսավորվեն:

- Կայքի բեռնման բարելավված ժամանակը. Կանխելով բոտերին մուտք գործել անկարևոր ռեսուրսներ՝ robots.txt-ը կարող է նվազեցնել սերվերի բեռնվածությունը՝ պոտենցիալ բարելավելով կայքի բեռնման ժամանակը, որը կարևոր գործոն է SEO-ում:

- Ոչ հրապարակային էջերի ինդեքսավորման կանխարգելում. Այն օգնում է զերծ մնալ ոչ հրապարակային տարածքներից (օրինակ՝ բեմադրող կայքերը կամ զարգացման տարածքները) ինդեքսավորվելուց և որոնման արդյունքներում հայտնվելուց:

Robots.txt Հիմնական հրամանները և դրանց օգտագործումը

- Թույլատրել Այս հրահանգը օգտագործվում է ճշտելու համար, թե կայքի որ էջերը կամ բաժինները պետք է մուտք գործեն սողուններ: Օրինակ, եթե վեբ կայքն ունի SEO-ի համար հատկապես համապատասխան բաժին, «Թույլատրել» հրամանը կարող է ապահովել, որ այն սուզվել է:

Allow: /public/- Արգելել՝ Հակառակ «Թույլատրել» հրամանին, այս հրամանը հրահանգում է որոնման համակարգի բոտերին չսողարկել կայքի որոշ հատվածներ: Սա օգտակար է SEO-ի արժեք չունեցող էջերի համար, ինչպիսիք են մուտքի էջերը կամ սցենարի ֆայլերը:

Disallow: /private/- Վայրի նշաններ. Վայրի նշաններն օգտագործվում են օրինաչափությունների համապատասխանության համար: Աստղանիշը (*) ներկայացնում է նիշերի ցանկացած հաջորդականություն, իսկ դոլարի նշանը ($) նշանակում է URL-ի ավարտը: Սրանք օգտակար են URL-ների լայն շրջանակ նշելու համար:

Disallow: /*.pdf$- Կայքի քարտեզներ: Ներառելով կայքի քարտեզի տեղադրությունը robots.txt-ում, որոնման համակարգերին օգնում են գտնել և սողալ կայքի բոլոր կարևոր էջերը: Սա շատ կարևոր է SEO-ի համար, քանի որ այն օգնում է կայքի ավելի արագ և ամբողջական ինդեքսավորմանը:

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt Լրացուցիչ հրամաններ և դրանց օգտագործումը

- Օգտագործող-գործակալ. Նշեք, թե որ սողունի վրա է կիրառվում կանոնը: 'User-agent. Օրինակ:

User-agent: Googlebot- Noindex: Թեև robots.txt ստանդարտ արձանագրության մաս չեն կազմում, որոշ որոնման համակարգեր հասկանում են ա noindex հրահանգը robots.txt-ում՝ որպես նշված URL-ը չինդեքսավորելու հրահանգ:

Noindex: /non-public-page/- Սողալ-ուշացում. Այս հրամանը սողացողներին խնդրում է սպասել որոշակի ժամանակ ձեր սերվերի հարվածների միջև, ինչը օգտակար է սերվերի բեռնվածության խնդիրներ ունեցող կայքերի համար:

Crawl-delay: 10Ինչպես փորձարկել ձեր Robots.txt ֆայլը

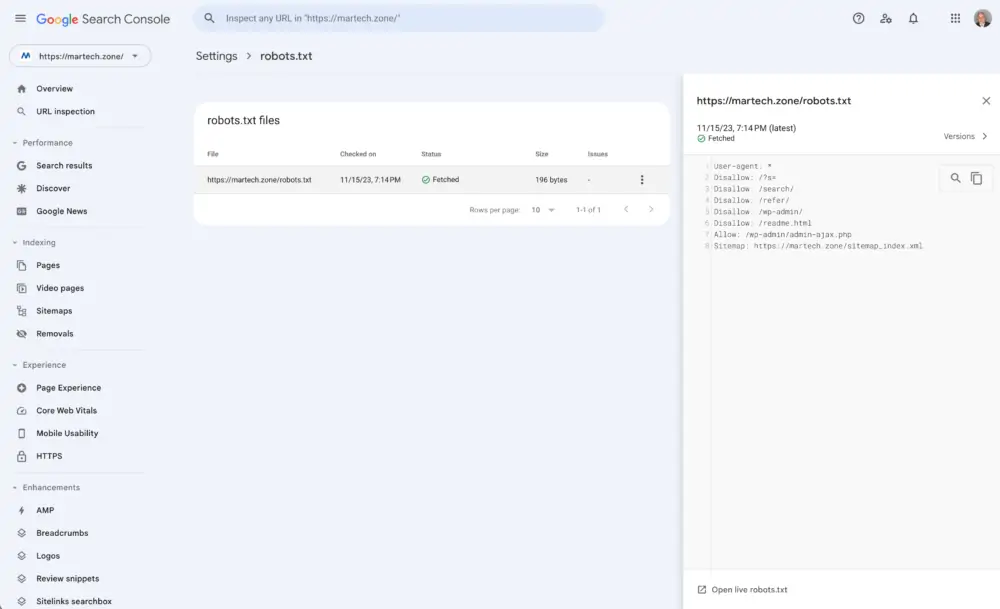

Չնայած այն թաղված է Google Search վահանակ, որոնման վահանակը առաջարկում է robots.txt ֆայլի փորձարկիչ:

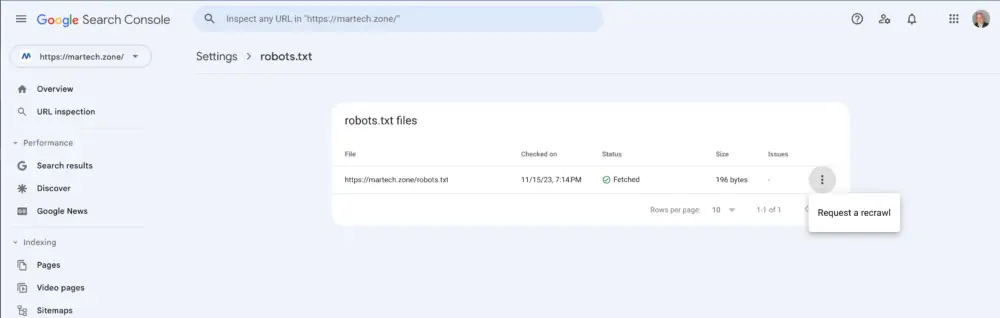

Կարող եք նաև նորից ուղարկել ձեր Robots.txt Ֆայլը՝ սեղմելով աջ կողմում գտնվող երեք կետերի վրա և ընտրելով Պահանջել Recrawl.

Փորձարկեք կամ նորից ներկայացրեք Ձեր Robots.txt ֆայլը

Կարո՞ղ է Robots.txt ֆայլը օգտագործվել AI բոտերը կառավարելու համար:

Robots.txt ֆայլը կարող է օգտագործվել որոշելու համար, թե արդյոք AI բոտերը, ներառյալ վեբ սողացողները և այլ ավտոմատացված բոտերը, կարող են սողալ կամ օգտագործել ձեր կայքի բովանդակությունը: Ֆայլը ուղղորդում է այս բոտերին՝ նշելով, թե վեբկայքի որ մասերն են նրանց մուտքը թույլատրված կամ արգելված: robots.txt-ի արդյունավետությունը, որը վերահսկում է AI բոտերի վարքագիծը, կախված է մի քանի գործոններից.

- Արձանագրությանը հավատարիմ մնալը. Որոնողական համակարգերի հեղինակավոր սողացողներից շատերը և շատ այլ AI բոտերը հարգում են սահմանված կանոնները

robots.txt. Այնուամենայնիվ, կարևոր է նշել, որ ֆայլն ավելի շատ խնդրանք է, քան կիրարկվող սահմանափակում: Բոտերը կարող են անտեսել այս հարցումները, հատկապես նրանք, որոնք շահագործվում են ոչ այնքան բծախնդիր կազմակերպությունների կողմից: - Հրահանգների առանձնահատկությունը. Դուք կարող եք տարբեր հրահանգներ նշել տարբեր բոտերի համար: Օրինակ, դուք կարող եք թույլ տալ կոնկրետ AI բոտերին սողալ ձեր կայքը, մինչդեռ թույլ չեն տալիս ուրիշներին: Սա արվում է օգտագործելով

User-agentհրահանգումrobots.txtֆայլի օրինակ վերևում: Օրինակ,User-agent: Googlebotկսահմաներ հրահանգներ Google-ի սողացողի համար, մինչդեռUser-agent: *կկիրառվեր բոլոր բոտերի համար: - Սահմանափակումները քանակը: Ժամանակ

robots.txtկարող է կանխել բոտերի կողմից նշված բովանդակությունը սողալը. այն չի թաքցնում բովանդակությունը նրանցից, եթե նրանք արդեն գիտեն URL. Բացի այդ, այն չի տրամադրում որևէ միջոց՝ սահմանափակելու բովանդակության օգտագործումը, երբ այն սուզվել է: Եթե պահանջվում է բովանդակության պաշտպանություն կամ օգտագործման հատուկ սահմանափակումներ, կարող են անհրաժեշտ լինել այլ մեթոդներ, ինչպիսիք են գաղտնաբառով պաշտպանությունը կամ մուտքի վերահսկման ավելի բարդ մեխանիզմները: - Բոտերի տեսակները. AI-ի ոչ բոլոր բոտերն են կապված որոնման համակարգերի հետ: Տարբեր բոտերն օգտագործվում են տարբեր նպատակների համար (օրինակ՝ տվյալների համախմբում, վերլուծություն, բովանդակության քերծում): Robots.txt ֆայլը կարող է օգտագործվել նաև այս տարբեր տեսակի բոտերի հասանելիությունը կառավարելու համար, քանի դեռ դրանք կառչում են REP-ին:

The robots.txt ֆայլը կարող է արդյունավետ գործիք լինել AI բոտերի կողմից կայքի բովանդակությունը սողալու և օգտագործման վերաբերյալ ձեր նախասիրությունների ազդանշան տալու համար: Այնուամենայնիվ, դրա հնարավորությունները սահմանափակվում են ուղեցույցներով, այլ ոչ թե մուտքի խիստ հսկողությամբ, և դրա արդյունավետությունը կախված է ռոբոտների համապատասխանությունից Robots Exclusion Protocol-ին:

Robots.txt ֆայլը փոքր, բայց հզոր գործիք է SEO-ի զինանոցում: Այն կարող է էապես ազդել կայքի տեսանելիության և որոնողական համակարգի աշխատանքի վրա, երբ այն ճիշտ օգտագործվում է: Վերահսկելով, թե կայքի որ մասերն են սուզվում և ինդեքսավորվում, վեբ վարպետները կարող են ապահովել, որ դրանց ամենաարժեքավոր բովանդակությունը ընդգծվի՝ բարելավելով իրենց SEO-ի ջանքերը և վեբ կայքի աշխատանքը: